Hay un informe dentro de Google Search Console que la mayoría de propietarios de webs nunca abre: el informe de estadísticas de rastreo. Se esconde dentro de Ajustes, en el menú lateral, y concentra información que no aparece en ningún otro lugar de la herramienta: cuántas veces visita Googlebot tu sitio, qué tipo de archivos rastrea, con qué rapidez responde tu servidor y, sobre todo, si hay algo que esté impidiendo que Google acceda correctamente a tu contenido.

Lo interesante de este informe es que no te dice si posicionas bien o mal, sino algo más fundamental: si Google puede acceder a tu web con normalidad. Y cuando hay un problema en esa capa, todo lo demás, el contenido, los enlaces y la estrategia de keywords queda en segundo plano.

Para que sea más fácil de entender, vamos a recorrer el informe usando datos reales de un nuevo cliente de nuestra agencia Top SEO.es, explicando qué significa cada número y qué conclusiones se pueden sacar de ellos.

Acceso rápido

- 1 Dónde encontrar el informe de estadísticas de rastreo

- 2 Las tres métricas principales del informe

- 3 El estado del host: lo primero que hay que mirar

- 4 El desglose de solicitudes: donde está la información más valiosa

- 5 Qué hacer con toda esta información

- 6 Lo que más preguntan los clientes

- 6.1 ¿Con qué frecuencia debo revisar las estadísticas de rastreo en Search Console?

- 6.2 ¿Qué porcentaje de errores 404 es aceptable en las estadísticas de rastreo?

- 6.3 ¿Por qué Googlebot rastrea más CSS e imágenes que HTML?

- 6.4 ¿Qué significa que el 97% de las visitas de Googlebot sean de actualización?

- 6.5 ¿Cómo puedo aumentar la frecuencia de rastreo de mi web?

Dónde encontrar el informe de estadísticas de rastreo

Para acceder a este informe, entra en tu propiedad de Search Console y ve al menú lateral. En la parte inferior encontrarás Ajustes. Dentro de esa sección, verás la opción Estadísticas de rastreo. Haz clic y accederás al informe completo.

Es importante tener en cuenta que este informe muestra datos de los últimos 90 días y no es retroactivo. Si acabas de configurar Search Console o tienes una web muy reciente, puede que los datos sean insuficientes para sacar conclusiones fiables.

Las tres métricas principales del informe

Lo primero que verás al abrir el informe son tres cifras en la parte superior, cada una con su propio gráfico de evolución en el tiempo.

Total de solicitudes de rastreo

Es el número total de veces que Googlebot ha visitado URLs de tu sitio en los últimos 90 días. En este ejemplo de un cliente, la cifra es de 8.550 solicitudes, con una media diaria que oscila entre 50 y 200 visitas, con algunos picos puntuales que superan las 350 en días concretos.

¿Es esa cifra alta o baja? Depende del tamaño del sitio. Para una web de tamaño medio como esta, con un centenar de posts publicados, es una frecuencia de rastreo saludable. Lo que importa no es tanto el número absoluto sino la tendencia: si las solicitudes de rastreo caen de forma sostenida sin que hayas cambiado nada en el sitio, puede ser una señal de que Google está encontrando problemas de acceso o de que ha reducido la prioridad de rastreo de tu dominio.

Los picos puntuales que se ven en el gráfico suelen coincidir con publicaciones de contenido nuevo, actualizaciones masivas o la obtención de nuevos enlaces externos que llevan a Googlebot a visitar el sitio con más frecuencia.

Tamaño total de la descarga

En el caso analizado, Google ha descargado 271 MB de datos de este sitio en 90 días. Esta métrica indica cuánta información transfiere tu servidor cada vez que Googlebot visita una URL.

Un tamaño de descarga excesivamente alto puede indicar que tu web tiene imágenes sin optimizar, archivos CSS o JavaScript demasiado pesados, o páginas con un volumen de código desproporcionado. Reducir el peso de los recursos que Googlebot descarga en cada visita es una de las formas de optimizar el crawl budget y conseguir que el rastreador dedique más visitas a páginas con contenido útil.

Tiempo medio de respuesta

Esta es la métrica más directamente relacionada con el rendimiento técnico de tu servidor. En esta web verás que el tiempo medio es de 645 milisegundos, lo que está dentro de un rango aceptable aunque con margen de mejora.

Como referencia orientativa, tiempos por debajo de 200ms se consideran excelentes, entre 200ms y 500ms son buenos, entre 500ms y 1.000ms son aceptables y por encima del segundo empiezan a ser problemáticos. Si el tiempo medio de respuesta de tu servidor supera los 2 segundos de forma sostenida, Google puede ralentizar su frecuencia de rastreo para no sobrecargar el servidor, lo que acaba afectando a la velocidad de indexación de contenido nuevo.

Este dato está directamente relacionado con la calidad de tu hosting y con las optimizaciones de WPO que tengas implementadas.

El estado del host: lo primero que hay que mirar

Justo debajo de las tres métricas principales aparece el estado del host, que en el caso analizado muestra un mensaje tranquilizador: «El host no tuvo problemas durante los últimos 90 días», acompañado de un icono verde.

Este apartado es el semáforo rápido del informe. Si en lugar del verde vieras un aviso en naranja o rojo, significaría que tu servidor ha tenido caídas o errores que impidieron a Googlebot acceder a tu web durante algún período. Eso es una señal de alerta que hay que resolver con urgencia, porque cada vez que el servidor falla y Googlebot se va con las manos vacías, estás perdiendo oportunidades de rastreo e indexación.

El desglose de solicitudes: donde está la información más valiosa

La parte inferior del informe es la que más información útil concentra. Se divide en cuatro bloques que analizan las solicitudes de rastreo desde perspectivas diferentes.

Por respuesta: el diagnóstico de salud más claro

Este bloque muestra qué código de respuesta HTTP ha devuelto tu servidor en cada visita de Googlebot. Es, probablemente, el dato más importante de todo el informe para detectar problemas técnicos.

En nuestro ejemplo:

| Código de respuesta | Porcentaje |

|---|---|

| Proceso correcto (200) | 77% |

| No se ha encontrado (404) | 18% |

| No se ha modificado (304) | 4% |

| Movido permanentemente (301) | 1% |

| Movido temporalmente (302) | <1% |

El 77% de respuestas 200 (correcto) es el porcentaje de solicitudes que han devuelto contenido sin problemas. Cuanto más alto sea este número, mejor.

El dato que llama la atención es el 18% de errores 404. Eso significa que casi una de cada cinco visitas de Googlebot acaba en una página que no existe. ¿Es esto grave? Depende de qué URLs estén generando esos 404. Si son URLs de páginas que borraste o moviste hace tiempo y que ya no tienen relevancia estratégica, el impacto es limitado. Si son páginas importantes con enlaces rotos que apuntaban a ellas, el problema es mayor porque estás desperdiciando link juice y crawl budget.

Para diagnosticar el origen de esos 404, lo más eficiente es cruzar este dato con el informe de páginas de Search Console, filtrado por el estado «No se ha encontrado (404)», y revisar qué URLs concretas están generando esos errores. Si alguna de ellas recibía tráfico o enlaces, lo correcto es implementar una redirección 301 hacia la URL más relevante del sitio.

El 4% de respuestas 304 (no modificado) indica que Googlebot ha visitado esas páginas y el servidor le ha informado de que el contenido no ha cambiado desde la última visita. Es un comportamiento normal y eficiente: significa que el servidor está usando correctamente la caché HTTP para evitar transferir contenido que Googlebot ya tiene almacenado.

El 1% de redirecciones 301 y el porcentaje residual de 302 son bajos y no generan preocupación. Un porcentaje muy alto de 301 podría indicar una cadena de redirecciones que conviene simplificar, pero en este caso no hay motivo de alarma.

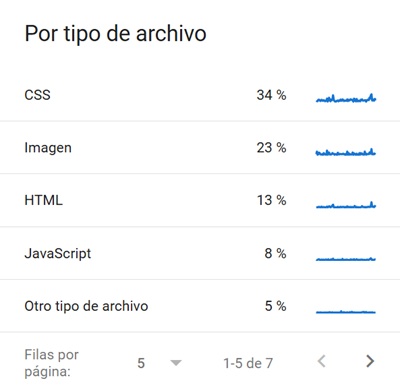

Por tipo de archivo: qué está rastreando Googlebot realmente

Este bloque revela algo que sorprende a mucha gente: Googlebot no solo rastrea el HTML de tus páginas. Descarga también CSS, imágenes, JavaScript y otros recursos para poder renderizar y entender el contenido tal y como lo vería un usuario real. En el pantallazo vemos:

| Tipo de archivo | Porcentaje |

|---|---|

| CSS | 34% |

| Imagen | 23% |

| HTML | 13% |

| JavaScript | 8% |

| Otro tipo de archivo | 5% |

Lo más llamativo aquí es que el HTML representa solo el 13% de las solicitudes, mientras que el CSS se lleva el 34% y las imágenes el 23%. Esto es completamente normal en el comportamiento de Googlebot moderno, que necesita descargar todos los recursos asociados a una página para renderizarla correctamente antes de indexarla.

Lo que sí conviene vigilar es si el porcentaje de HTML es muy bajo en relación al resto. Si Googlebot dedica la mayor parte de su presupuesto de rastreo a descargar CSS e imágenes en lugar de HTML con contenido, puede que haya margen para optimizar qué recursos son accesibles al rastreador mediante el archivo robots.txt y cuáles no necesita descargar.

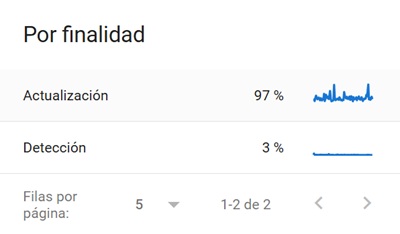

Por finalidad: actualización vs detección

Este bloque diferencia entre dos tipos de visitas de Googlebot. Las visitas de actualización (97% en este caso) son las que Googlebot realiza para comprobar si el contenido de una página que ya conoce ha cambiado. Las visitas de detección (3%) son las que realiza para descubrir URLs nuevas que aún no ha rastreado.

Un porcentaje tan alto de actualización frente a detección es normal en un sitio con cierta madurez. Indica que Googlebot ya conoce bien la estructura del sitio y la mayor parte de sus visitas van orientadas a mantener actualizado su índice. Si el porcentaje de detección fuera muy bajo en un sitio que publica contenido nuevo con frecuencia, podría ser una señal de que el enlazado interno no está llevando a Googlebot hacia las páginas nuevas de forma eficiente.

Por tipo de robot de Google: quién visita tu web

Este es el bloque que más confusión genera y el que más información aporta sobre cómo Google está rastreando tu sitio. En este este ejemplo los datos son:

| Tipo de robot | Porcentaje |

|---|---|

| Carga de recursos de la página | 55% |

| Smartphones | 28% |

| Ordenador | 7% |

| Imagen | 7% |

| Otro tipo de agente | 3% |

El 55% correspondiente a carga de recursos confirma lo que veíamos en el bloque de tipo de archivo: más de la mitad de las visitas de Googlebot van dirigidas a descargar CSS, JavaScript e imágenes, no el contenido HTML en sí.

El 28% de Googlebot para smartphones frente al 7% de Googlebot para ordenador es coherente con el hecho de que Google usa el rastreo mobile-first como criterio principal de indexación desde 2019. Que el robot de smartphones sea el que más rastreo de contenido HTML hace (frente al de escritorio) es exactamente lo que debe ocurrir en una web bien configurada.

Si en tu sitio el porcentaje de Googlebot para smartphones fuera muy bajo o inexistente, sería una señal de alerta que sugeriría revisar si tu web está correctamente adaptada para el rastreo en dispositivos móviles.

Qué hacer con toda esta información

Interpretar el informe de estadísticas de rastreo no sirve de nada si no lleva a acciones concretas. Estas son las que tienen más impacto en la práctica:

- Si tienes un porcentaje alto de errores 404, identifica las URLs concretas, comprueba si recibían tráfico o enlaces y aplica redirecciones 301 hacia las páginas más relevantes. Prioriza las que tenían más autoridad.

- Si el tiempo medio de respuesta supera los 800-1.000ms, revisa la calidad de tu hosting, activa la caché si no la tienes configurada y analiza si hay plugins o scripts que estén ralentizando la respuesta del servidor.

- Si el porcentaje de HTML rastreado es muy bajo en relación al total de solicitudes, plantéate si tiene sentido bloquear en robots.txt algunos recursos que Googlebot no necesita descargar para entender tu contenido.

- Si las solicitudes de rastreo caen de forma sostenida sin causa aparente, revisa el estado del host, comprueba si hay errores de servidor recurrentes y analiza si algún cambio reciente en el sitio puede haber reducido la frecuencia con la que Googlebot lo visita.

Combinar este informe con el de páginas de Search Console y con las estadísticas de rastreo del archivo robots.txt da una imagen bastante completa del estado técnico de un sitio. Es una de las revisiones que hacemos de forma periódica en los proyectos que gestionamos como agencia especializada en SEO porque permite detectar problemas antes de que afecten al posicionamiento de forma visible.

Lo que más preguntan los clientes

¿Con qué frecuencia debo revisar las estadísticas de rastreo en Search Console?

Una revisión mensual es suficiente para la mayoría de sitios. Sin embargo, conviene revisar este informe inmediatamente después de hacer cambios importantes en la web, como migraciones, cambios de estructura de URLs, actualizaciones del archivo robots.txt o publicaciones masivas de contenido. También es recomendable revisarlo si detectas caídas de tráfico orgánico sin una causa aparente en los informes de rendimiento.

¿Qué porcentaje de errores 404 es aceptable en las estadísticas de rastreo?

No hay un umbral universal, pero un porcentaje por encima del 10-15% merece atención. Lo más importante no es el porcentaje en sí sino qué URLs están generando esos errores. Si son páginas antiguas sin relevancia estratégica ni enlaces apuntando a ellas, el impacto es limitado. Si son páginas que recibían tráfico o tenían enlaces externos de calidad, conviene implementar redirecciones 301 hacia las páginas más relevantes del sitio.

¿Por qué Googlebot rastrea más CSS e imágenes que HTML?

Porque Google necesita descargar todos los recursos asociados a una página para poder renderizarla y entender su contenido tal y como lo vería un usuario real. Desde que Google adoptó el renderizado de páginas como parte de su proceso de indexación, Googlebot descarga CSS, JavaScript e imágenes además del HTML para tener una visión completa del contenido antes de indexarlo. Esto es un comportamiento normal y esperado.

¿Qué significa que el 97% de las visitas de Googlebot sean de actualización?

Significa que Googlebot ya conoce bien la estructura del sitio y dedica la mayor parte de sus visitas a comprobar si el contenido de páginas que ya tiene indexadas ha cambiado. Es un comportamiento normal en sitios con cierta madurez. Un porcentaje alto de visitas de detección indicaría que Googlebot está descubriendo muchas URLs nuevas, lo que es más frecuente en sitios que acaban de arrancar o que están creciendo muy rápido en número de páginas.

¿Cómo puedo aumentar la frecuencia de rastreo de mi web?

Google determina la frecuencia de rastreo de forma automática en función de la autoridad del dominio, la velocidad del servidor y la frecuencia con la que se actualiza el contenido. Para favorecer un rastreo más frecuente conviene publicar contenido nuevo de forma regular, mejorar el tiempo de respuesta del servidor, mantener un sitemap actualizado, asegurarse de que el enlazado interno lleva a Googlebot hacia las páginas más importantes y corregir los errores que aparecen en el informe de estadísticas de rastreo.